Tecnologia e Ética: O Que Está em Jogo na Era da Inteligência Artificial

Você já parou pra pensar como as ferramentas de inteligência artificial mudaram nossa vida? Hoje em dia, IA não serve só pra responder perguntas rápidas ou organizar agendas. Ela também cria textos, imagens e até vídeos praticamente do zero. Isso tudo pode ser incrível, mas também traz um monte de discussões éticas, principalmente quando entramos no tema de conteúdos impróprios.

O que acontece quando uma IA começa a produzir materiais ofensivos, enganosos ou que simplesmente não deveriam circular por aí? É aí que a tecnologia bate de frente com a ética. Quem é o responsável pelo que uma IA gera? O programador? O usuário? Ou a máquina, que na real só segue comandos?

Esse papo não é só teoria. Já rolou de ferramentas famosas soltarem imagens falsas e textos que espalham desinformação, tudo com um clique. E controlar isso não é tão simples. Sistemas de moderação entram em cena, tentando filtrar o que não presta, mas nem sempre conseguem pegar tudo. Às vezes, o algoritmo pode até errar, barrando conteúdos que são totalmente aceitáveis.

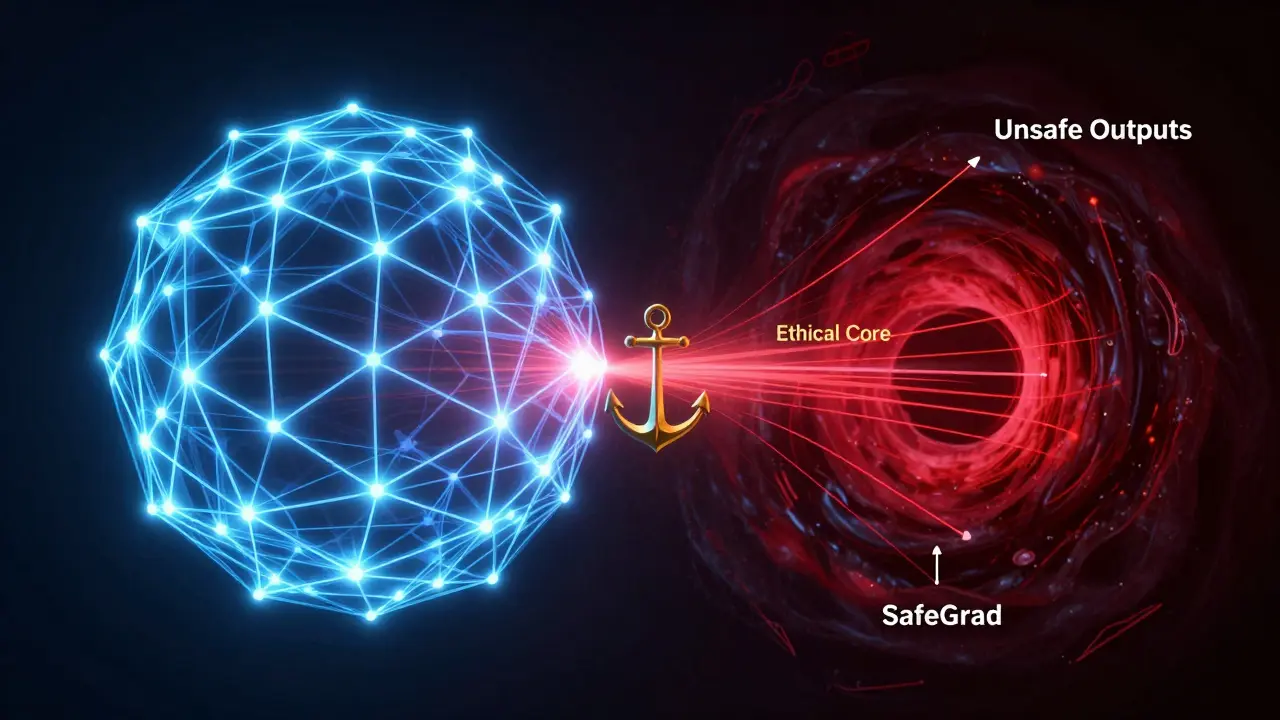

Pra segurar essa onda, o pessoal que desenvolve IA está sempre buscando novas formas de ensinar as máquinas a dizer "não" pra pedidos problemáticos. Isso inclui treinar com exemplos éticos, criar filtros cada vez mais espertos e escutar o que a galera do lado de cá – usuários comuns – está achando. A comunidade de tecnologia já percebeu que, sem essas barreiras, a IA pode reforçar preconceitos ou piorar situações delicadas.

Agora, imagina o impacto disso tudo na vida da gente. Mais do que nunca, a ética precisa andar junto com a tecnologia. E não é só papo de especialista, não. Cada vez que você usa uma ferramenta de IA, influencia esse ecossistema. Ao cobrar transparência, denunciar problemas e buscar informações confiáveis, você ajuda a deixar o ambiente digital mais seguro pra todo mundo.

Por trás das novidades, existe também uma corrida pra regulamentar o uso de IA. Vários países já discutem leis específicas pra garantir que a tecnologia sirva pra melhorar e não pra prejudicar. Ou seja, esse assunto tá ficando sério além das telas dos computadores.

Em resumo, tecnologia e ética precisam caminhar lado a lado. Do mesmo jeito que a IA pode facilitar nossa vida, ela também carrega riscos reais. Ficar de olho nas discussões, saber como a moderação funciona e entender seus direitos é o caminho mais prático pra não ser pego de surpresa no meio desse avanço todo. Com esse olhar crítico, dá pra aproveitar o melhor da tecnologia, sem abrir mão do bom senso.