Basicamente, o Shadow AI acontece quando colaboradores usam ferramentas de inteligência artificial sem que o departamento de TI ou a diretoria saibam. Não estamos falando apenas de usar o ChatGPT para escrever um e-mail, mas de integrar fluxos de trabalho inteiros em ferramentas que não passaram por nenhuma auditoria de segurança. O risco não está na tecnologia em si, mas na falta de controle sobre onde as informações da empresa estão indo.

Os principais perigos para a segurança da informação

Quando alguém utiliza uma ferramenta de IA "na surdina", o primeiro e mais grave risco é o vazamento de dados sensíveis. A maioria das IAs generativas utiliza as interações dos usuários para treinar versões futuras do modelo. Se você insere um código-fonte proprietário ou a estratégia de preços de 2026 em um prompt, esses dados tornam-se parte do conhecimento da máquina.

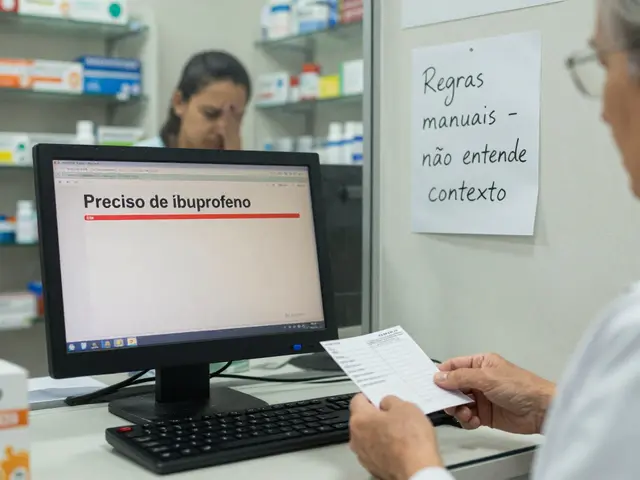

Além disso, temos a questão da conformidade legal. No Brasil, a LGPD é a Lei Geral de Proteção de Dados Pessoais, que regula como as empresas devem tratar informações de cidadãos. Se um colaborador usa uma IA estrangeira para processar dados de clientes brasileiros sem consentimento ou base legal, a empresa está cometendo uma infração grave que pode resultar em multas milionárias.

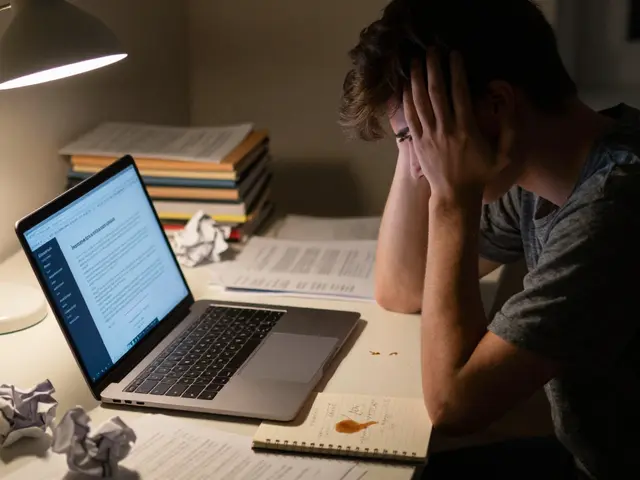

Outro ponto crítico é a "alucinação" da IA. Quando um funcionário confia cegamente em um resultado gerado por uma ferramenta não homologada para tomar decisões financeiras ou jurídicas, ele pode estar baseando a estratégia da empresa em fatos inventados pela máquina. Sem uma governança clara, não há quem valide se aquela informação é real ou um erro plausível do modelo.

| Característica | IA Corporativa (Homologada) | Shadow AI (Não autorizada) |

|---|---|---|

| Privacidade de Dados | Contratos de não-treinamento (Enterprise) | Dados usados para treinar a IA pública |

| Controle de Acesso | Gerenciado pelo TI (Single Sign-On) | Contas pessoais e senhas fracas |

| Conformidade Legal | Alinhada à LGPD e políticas internas | Risco alto de violação de privacidade |

| Suporte e Auditoria | Logs de uso e suporte técnico | Caminho invisível, sem rastreabilidade |

O impacto na governança e na cultura organizacional

A existência de Shadow AI revela um gap perigoso na cultura de tecnologia da empresa. Muitas vezes, os funcionários recorrem a essas ferramentas porque as soluções oficiais são lentas, burocráticas ou inexistentes. Isso cria um ambiente onde a "produtividade rebelde" se torna a norma, mas a um custo invisível para a segurança do negócio.

Quando o TI não sabe quais ferramentas estão sendo usadas, ele não consegue aplicar patches de segurança ou monitorar vulnerabilidades. Se a conta de um colaborador for hackeada em um serviço de IA gratuito, o invasor pode ter acesso a todo o histórico de prompts, que geralmente contém segredos industriais, senhas anotadas ou detalhes de projetos sigilosos.

Além disso, a falta de padronização gera a "fragmentação do conhecimento". Imagine cinco pessoas usando cinco IAs diferentes para analisar o mesmo problema. Cada modelo tem vieses e lógicas distintas, resultando em conclusões conflitantes que confundem a gestão e dificultam a criação de um processo replicável e escalável.

Como mitigar os riscos sem matar a inovação

Tentar proibir a IA completamente é a pior estratégia possível. O funcionário que quer ser produtivo continuará usando a ferramenta, mas agora ele terá medo de contar para o chefe, tornando o Shadow AI ainda mais "sombrio". A solução é a transparência e a educação.

O primeiro passo é criar uma Política de Uso de IA clara. Não precisa ser um documento jurídico chato, mas um guia prático que diga: "Pode usar a IA para estruturar e-mails, mas nunca insira dados de clientes ou códigos de segurança". Quando as pessoas sabem onde está a linha vermelha, a chance de erro diminui drasticamente.

Outra medida eficaz é a implementação de Enterprise AI, que são versões corporativas de modelos de linguagem que garantem que os dados inseridos não sejam usados para treinar o modelo global. Ao oferecer a ferramenta oficial e segura, a empresa remove a necessidade de o colaborador buscar alternativas arriscadas na internet.

Por fim, invista em treinamento de prompts. Muitas vezes, o risco do Shadow AI vem de prompts mal formulados que expõem mais dados do que o necessário. Ensinar a equipe a criar prompts anônimos (onde se removem nomes e marcas) protege a empresa enquanto mantém a agilidade do trabalho.

Checklist para auditoria de Shadow AI na sua empresa

Se você suspeita que sua equipe está usando ferramentas de IA por fora, use estes passos para mapear a situação:

- Analise os logs de tráfego de rede para identificar acessos frequentes a domínios de LLMs (como openai.com, anthropic.com ou perplexity.ai).

- Faça uma pesquisa anônima com os colaboradores perguntando quais ferramentas de IA eles consideram essenciais para o dia a dia.

- Verifique se há contas corporativas cadastradas em serviços de IA via e-mail de empresa, mas sem gestão de admin.

- Avalie a qualidade dos entregáveis: se a produtividade subiu drasticamente em áreas específicas, provavelmente há uma IA operando nos bastidores.

- Revise os contratos de software (SaaS) da empresa para ver se eles já integraram funções de IA que você nem sabia que existiam.

Conectando a IA à estratégia de negócios

O Shadow AI não é apenas um problema técnico; é um sintoma de desejo por eficiência. O segredo para domar esse risco é transformar a IA invisível em um ativo visível. Quando a empresa assume a liderança da adoção tecnológica, ela deixa de ser a "polícia do software" e passa a ser a facilitadora da inovação.

Isso envolve entender que a inteligência artificial agora é uma competência básica, como saber usar o Excel foi nos anos 90. A diferença é que a IA mexe com a camada mais profunda da empresa: a informação. Portanto, a governança deve ser dinâmica, revisando as ferramentas e permissões a cada trimestre, já que o cenário de IA muda quase semanalmente.

O que exatamente define o Shadow AI?

O Shadow AI é o uso de softwares, aplicativos ou serviços de inteligência artificial dentro de uma organização sem a aprovação, conhecimento ou gestão do departamento de TI. Isso inclui desde chatbots simples até ferramentas complexas de análise de dados baseadas em IA.

Como a LGPD se aplica ao uso de IAs não autorizadas?

Se um colaborador insere dados pessoais de clientes em uma IA pública, ele está transferindo esses dados para um terceiro sem base legal. Isso viola os princípios de finalidade e segurança da LGPD, podendo gerar sanções administrativas e judiciais para a empresa, que é a controladora dos dados.

Qual a diferença entre a versão gratuita e a corporativa da IA em termos de risco?

Versões gratuitas geralmente usam seus dados para treinar a IA, o que significa que informações confidenciais podem aparecer em respostas para outros usuários. Versões corporativas (Enterprise) geralmente oferecem contratos de privacidade que garantem que os dados fiquem isolados e não sejam usados para treinamento do modelo global.

Proibir a IA resolve o problema do Shadow AI?

Não. Proibições rígidas tendem a empurrar o uso para a clandestinidade. O colaborador continuará usando a ferramenta em dispositivos pessoais ou redes externas, mas não reportará erros ou vazamentos, tornando o risco ainda maior por ser invisível.

O que são 'alucinações' de IA e por que são um risco corporativo?

Alucinações ocorrem quando a IA gera informações falsas, mas com tom de total certeza. No contexto corporativo, isso pode levar a erros em relatórios financeiros, citações de leis inexistentes em contratos ou decisões estratégicas baseadas em dados fictícios.

11 Comentários

Sinceramente... achei ingenuo demais achar q o TI consegue controlar isso. O cara que sabe mexer na ferramenta vai usar a VPN dele ou o 4g do celular e pronto!! O sistema de vcs é que é lento e burocratiko, ai a gente tem que se virar pra entregar o resultado que o chefe pede!!!!

É ABSURDO que ainda precisemos discutir isso em pleno 2024! A negligência com a LGPD é gritante e quem ignora a governança de dados está brincando com fogo! Não é apenas um 'erro de funcionário', é uma falha moral da gestão que não educa sua equipe sobre a sacralidade da informação proprietária! Um desastre anunciado!

Nossa, que texto super original sobre Shadow AI. Aposto que o autor usou uma IA pra escrever isso e nem percebeu que tá pregando pra conversão kkkk. A produtividade rebelde é a única coisa que mantém algumas empresas vivas enquanto o TI dorme no ponto.

Eu concordo plenamente que a proibição não é o caminho, pois quando fechamos as portas para a inovação, acabamos por alienar os talentos mais proativos da equipe, que são justamente aqueles que buscam formas de otimizar o trabalho. O ideal seria realmente a criação de um ambiente de confiança mútua onde o colaborador se sinta confortável em dizer 'eu descobri essa ferramenta e acho que ela nos ajudaria', permitindo que o departamento de tecnologia valide a solução de forma ágil, sem burocracias excessivas que matem a vontade de evoluir, garantindo assim que a LGPD seja respeitada sem que a empresa se torne obsoleta frente aos concorrentes que já adotaram essas tecnologias de forma estratégica e segura.

Olha... a verdade é q a maioria nem sabe o que é um prompt decente....!!!! Usar IA sem saber de governança é pedir pra ser demitido por justa causa!!!! O nível de amadorismo nas empresas brasileiras é assustador!!!!

Em Portugal já temos protocolos muito mais rigorosos sobre isso, pois não somos tão descuidados com a nossa soberania de dados como acontece por aí 🙄. A incompetência de quem deixa vazar dados de clientes em chats públicos é patética e reflete a falta de instrução básica de quem opera essas máquinas. É rídiculo que precisem de um checklist para notar que a rede está sendo usada para fins não autorizados! 💅

O homem moderno trocou a ética pela pressa. A gente não quer mais pensar, quer que a máquina pense por nós. Esse tal de Shadow AI é só o reflexo de que ninguém mais tem paciência pra aprender a fazer as coisas do jeito certo. A verdade é que a empresa que não controla isso não tem alma, só tem processos que ninguém segue.

MANO EU JA FUI BRIGADO POR ISSO E O CHEFE NEM SABIA USAR O GOOGLE!!!! É UM ABSURDO!!! A gente tenta ajudar a empresa a crescer e a gente é que sai como o vilão da história por causa de uns dadinhos que nem servem pra nada!!!! Que palhaçada!!!!

A tragédia aqui é que a maioria de vocês nem percebeu que a alucinação da IA é o menor dos problemas. O verdadeiro drama é a perda total da autoria intelectual! Estamos criando uma geração de 'copia e cola' que não sabe validar a própria entrega. É o apocalipse da competência profissional!

Acho que podemos olhar por um lado positivo! Isso mostra que as pessoas estão motivadas a melhorar os processos. Se a empresa der a mão e fornecer a ferramenta certa, como as versões Enterprise, vai ter um salto de produtividade incrível e seguro para todos. Vamos transformar esse medo em oportunidade de aprendizado!

Engraçado que todo mundo fala de risco, mas ninguém fala que a maioria dessas ferramentas 'homologadas' que o TI instala são versões capadas que não servem pra nada na prática. No fim, o Shadow AI é a única forma de realmente tirar proveito da tecnologia sem passar por dez camadas de aprovação de quem nem sabe abrir um PDF.