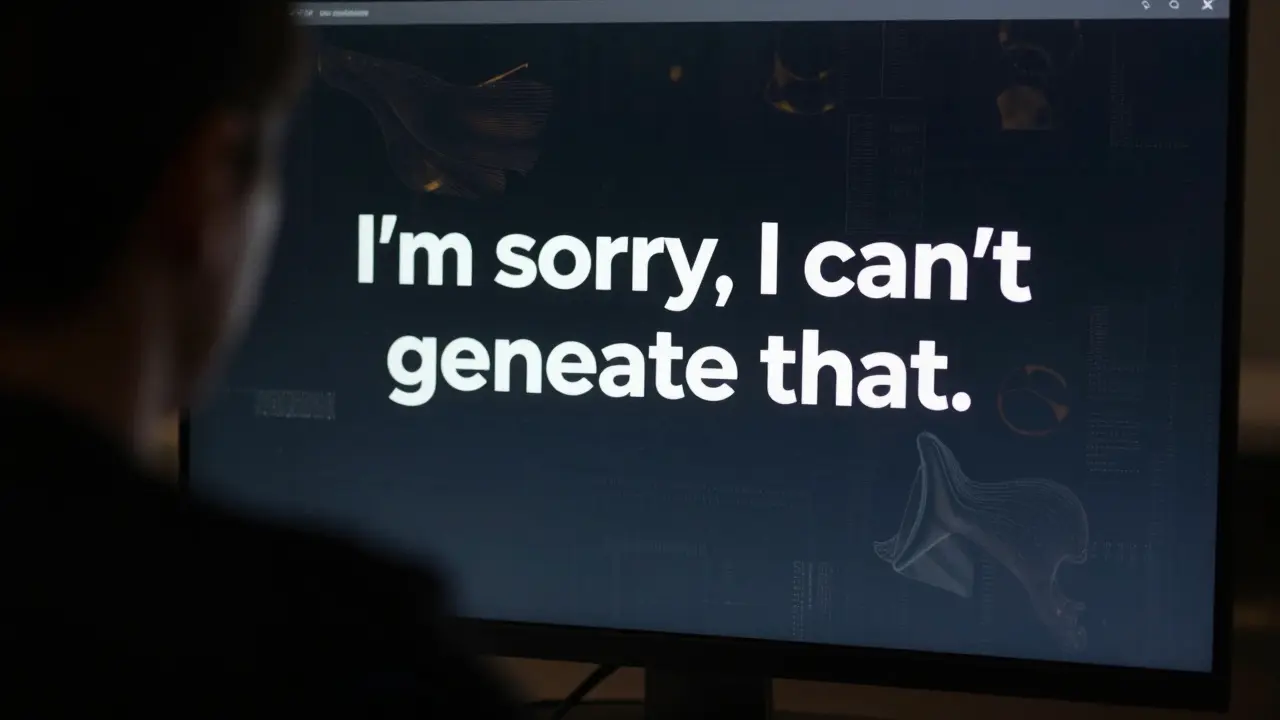

Se você já tentou pedir ao DALL·E para criar uma imagem com conteúdo sexual, explícito ou violento, provavelmente já viu aquela mensagem simples, mas firme: "I'm sorry, I can't generate that." Mas será que isso é realmente um bloqueio técnico, ou algo mais profundo? A resposta não é só sobre algoritmos - é sobre políticas, limites éticos e como a IA está sendo moldada para não repetir os erros do passado.

Como o DALL·E detecta o que é NSFW

O DALL·E não está apenas procurando por palavras como "nude" ou "sex". Ele analisa padrões visuais, contextos e até associações semânticas. Por exemplo, pedir "uma mulher de biquíni na praia" pode gerar uma imagem perfeitamente aceitável. Mas se você mudar para "uma mulher de biquíni em posição sexual explícita", mesmo sem usar palavras ofensivas, o sistema entende a intenção. Isso acontece porque o modelo foi treinado com milhões de imagens e textos, e aprendeu a associar certas combinações com conteúdo proibido.

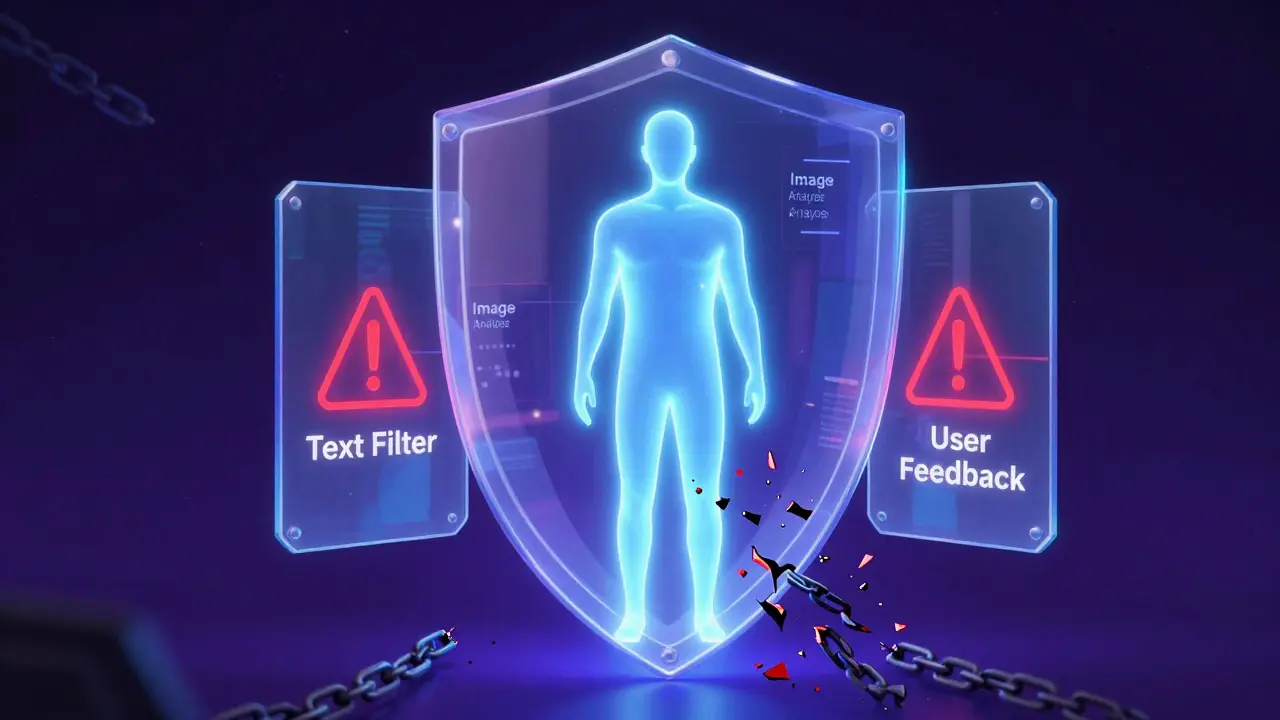

OpenAI não deixou isso ao acaso. Eles usaram filtros de conteúdo em múltiplas camadas: um filtro de texto que analisa o prompt, outro que examina a imagem gerada antes de ser liberada, e um terceiro que revisa feedbacks de usuários. Se muitas pessoas tentam gerar o mesmo tipo de imagem, mesmo com variações criativas, o sistema aprende e bloqueia automaticamente.

Por que a OpenAI bloqueia isso?

Em 2023, um estudo da Universidade de Stanford mostrou que modelos de IA sem restrições geravam conteúdo abusivo em até 18% dos casos quando solicitados de forma sutil. Isso não é só sobre moralidade - é sobre responsabilidade legal. Empresas que permitem a geração de imagens não consensuais, mesmo que fictícias, correm risco de processos por violação de direitos humanos e difamação. A OpenAI, por exemplo, já enfrentou críticas por ter permitido, em versões anteriores, a geração de rostos de celebridades em contextos inapropriados.

Além disso, há o impacto social. Imagens NSFW geradas por IA estão sendo usadas para assédio, manipulação e até extorsão. Em Portugal, em 2024, houve um aumento de 47% nos casos de deepfakes sexuais reportados à Autoridade Nacional de Cibersegurança. Bloquear essas gerações é uma forma de proteger pessoas reais - mesmo que o pedido seja feito "só por curiosidade".

O que acontece se você tentar burlar o bloqueio?

As pessoas tentam de tudo: sinônimos em outros idiomas, descrições vagas, metáforas, até pedidos em código. Alguns tentam "uma mulher vestida de forma sensual em um ambiente íntimo". Outros usam palavras como "artistic nude" ou "classical painting". O DALL·E ainda bloqueia. Por quê? Porque o modelo foi treinado para entender intenção, não apenas palavras.

Em 2025, a OpenAI atualizou o sistema para reconhecer até 200 variações de solicitações NSFW, incluindo termos em espanhol, francês e português. Tentar usar "nua", "desnuda" ou "sexo" em português não funciona. O sistema já foi ajustado para detectar essas variações regionais. E se você continuar tentando? O sistema pode limitar seu acesso temporariamente ou, em casos repetidos, bloquear sua conta.

Existem alternativas que permitem NSFW?

Sim - mas com grandes ressalvas. Modelos como Stable Diffusion, quando rodados localmente em seu próprio computador, podem gerar esse tipo de conteúdo. Alguns modelos treinados especificamente para isso, como SDXL-Nudity ou DreamShaper XL, são usados por artistas e pesquisadores em ambientes controlados. Mas essas versões não estão disponíveis em plataformas públicas como o site da OpenAI.

Quem usa essas ferramentas precisa entender: gerar imagens NSFW com IA não é só uma questão técnica. É uma escolha ética. Muitos desses modelos são treinados com dados coletados sem consentimento de pessoas retratadas. Mesmo que você não use rostos reais, a geração de corpos sexualizados sem autorização contribui para um ecossistema tóxico.

Além disso, plataformas como ArtStation, DeviantArt e mesmo o Reddit baniram totalmente esse tipo de conteúdo. Se você planeja compartilhar ou monetizar essas imagens, corre o risco de perder acesso a mercados, redes e comunidades inteiras.

Quem decide o que é NSFW?

Essa é a pergunta mais difícil. Não existe um consenso global. O que é considerado explícito em Lisboa pode ser aceitável em Tóquio. A OpenAI adotou um padrão baseado em leis dos EUA e da União Europeia - especialmente na LGPD e no GDPR - que proíbem a criação de conteúdo sexualizado envolvendo pessoas, mesmo que fictícias. Isso inclui nudes, atividades sexuais, violência sexual e qualquer representação que possa ser interpretada como não consensual.

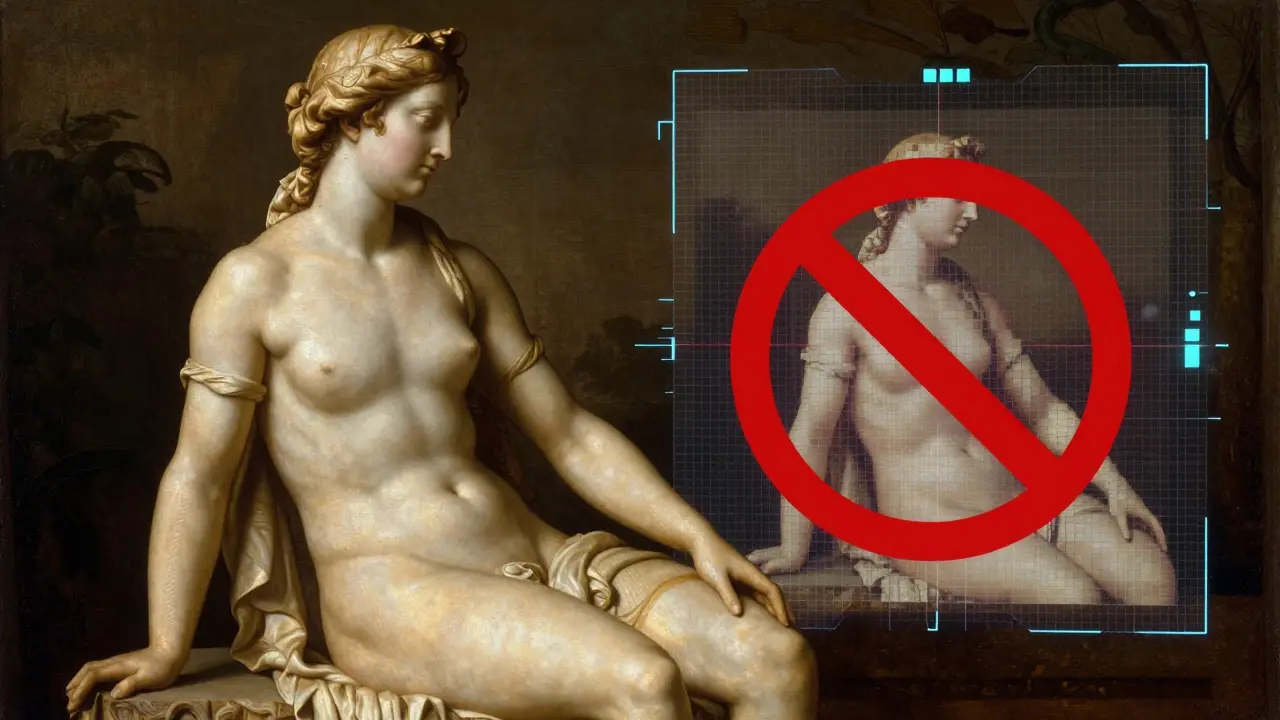

Isso significa que mesmo imagens de corpos artísticos, como pinturas renascentistas, são bloqueadas se o sistema as classificar como "potencialmente explícitas". É um sistema conservador por design - e isso é intencional. A empresa prefere bloquear 100 imagens legítimas do que permitir uma única imagem que possa causar dano real.

Como usar o DALL·E de forma responsável

Se você quer criar arte, ilustrações ou imagens criativas, o DALL·E é incrível. Ele pode gerar cenas surreais, retratos históricos, personagens de fantasia e paisagens impossíveis - tudo sem tocar em limites éticos. Em vez de pedir "nude", tente: "uma mulher em um vestido de néon, em uma cidade futurista, estilo cyberpunk, iluminação dramática". O resultado é mais original, mais impactante e totalmente permitido.

Use o DALL·E para expandir sua criatividade, não para testar seus limites. As melhores imagens que surgem da IA são aquelas que desafiam a realidade, não as que a violam.

Se você precisa de imagens com nudez artística, o que fazer?

Existem bibliotecas de imagens licenciadas que oferecem nudez artística com consentimento: sites como Unsplash e Pexels têm coleções específicas de fotografia artística, todas com modelos reais que autorizaram o uso. Para projetos profissionais, como capas de livros ou exposições, essas são as opções seguras e éticas.

Se você é artista e quer criar algo original, use o DALL·E para gerar ideias de composição, iluminação e estilo - depois, transforme isso em arte manual ou com ajuda de um fotógrafo. A IA é uma ferramenta, não um substituto para o julgamento humano.

DALL·E bloqueia imagens NSFW mesmo que eu use palavras em outro idioma?

Sim. O sistema foi atualizado para reconhecer termos em português, espanhol, francês, alemão e outros idiomas comuns. Mesmo que você use sinônimos ou expressões indiretas, o modelo entende o contexto e bloqueia. A OpenAI treinou o sistema para detectar intenção, não apenas palavras-chave.

Posso usar o DALL·E para gerar imagens de artistas famosos nus?

Não. Mesmo que a imagem seja fictícia, gerar representações de pessoas reais em contextos sexuais ou explícitos é proibido. Isso se enquadra como deepfake e viola políticas de privacidade e direitos de imagem. O sistema bloqueia automaticamente nomes de celebridades em combinações sensíveis.

O que acontece se eu continuar tentando gerar conteúdo NSFW?

Se você tentar repetidamente, o sistema pode limitar suas gerações por 24 a 72 horas. Em casos extremos - como tentativas constantes, uso de contas múltiplas ou tentativas de burlar o sistema - sua conta pode ser suspensa permanentemente. Não há aviso prévio. O bloqueio é automático e baseado em padrões de uso.

O DALL·E bloqueia também imagens de crianças ou figuras juvenis?

Sim, e com ainda mais rigor. Qualquer tentativa de gerar imagens que possam ser interpretadas como envolvendo menores - mesmo que fictícias - é imediatamente bloqueada e relatada às autoridades. Isso inclui roupas sugestivas, poses inadequadas ou ambientes que sugerem vulnerabilidade. A OpenAI segue as diretrizes da ICMEC e da União Europeia nesse ponto.

Existe alguma versão do DALL·E que permita NSFW?

Não. Nenhuma versão pública do DALL·E - seja pela API, no site da OpenAI ou em apps oficiais - permite esse tipo de conteúdo. Versões não oficiais ou modificadas existem, mas são ilegais, inseguras e violam os termos de uso. Usá-las expõe você a riscos de malware, vazamento de dados e consequências legais.

O que fazer se você quer explorar o lado artístico da nudez

Se sua intenção é criar arte, não conteúdo explícito, existem caminhos melhores. Estude a história da arte: como Rubens, Renoir e Modigliani representavam o corpo humano com dignidade e técnica. Use o DALL·E para gerar esboços de composição, iluminação e estilo - depois, desenvolva isso manualmente. Isso não só evita problemas legais, como torna seu trabalho mais autêntico.

Em Portugal, artistas como Paula Rego usaram a figura humana para explorar emoções, poder e identidade - sem jamais recorrer à exploração sexual. A arte não precisa de nudez explícita para ser poderosa. Às vezes, o que é sugerido é mais impactante do que o que é mostrado.

Use a IA como um aliado da criatividade, não como um atalho para o choque. Os melhores resultados vêm quando você respeita os limites - e os desafia com inteligência, não com provocação.

10 Comentários

Realmente, o DALL·E tá mais conservador que minha vó na missa. Mas no fundo, é bom assim. Ninguém precisa ver corpos digitais sendo usados como troféus.

KKKKKKKKKKK eu tentei pedir ‘uma mulher de biquíni… em posição de yoga avançada’… e ele falou ‘não posso gerar isso’… mas aí eu coloquei ‘yoga em ambiente íntimo’ e ele entendeu, mano… ele é mais esperto que o meu ex!

Essa questão do bloqueio não é só técnica, é moral, sim, mas também pragmática. A OpenAI não tá sendo hipócrita - ela tá tentando evitar um caos. Imagina se qualquer um pudesse gerar imagens de pessoas reais nus, mesmo que fictícias? Aí a gente vira uma fábrica de abuso digital. E não é só sobre ‘liberdade de expressão’ - é sobre proteção real. Mulheres, crianças, vítimas de assédio… elas não pediram pra virar meme. E o sistema tá certo em bloquear. Mesmo que isso atrapalhe artistas que querem explorar o corpo humano com respeito. Aí é problema de como pedir. Não de se bloquear. A IA pode ser usada pra criar algo lindo, sem precisar da exploração. A arte não precisa de nudez explícita pra ser poderosa. Pode ser sugerida. Pode ser poética. Pode ser silenciosa. E às vezes, o que não se vê, dói mais, e fica mais tempo na cabeça.

Em Portugal, já vi gente usando IA pra criar arte clássica com inspiração renascentista - e funcionou lindo! Sem precisar de nudes. O DALL·E é uma ferramenta, não um brinquedo pra testar limites. Se você quer fazer arte séria, você vai achar um jeito. E se não achar, talvez o problema não seja o bloqueio… mas a sua intenção.

Se o DALL·E bloqueia tudo que tem ‘nua’ ou ‘sexo’, então por que ele deixa ‘mulher de biquíni na praia’? É só porque a praia é pública? Isso é hipocrisia. O sistema é arbitrário. Se você pedir ‘uma mulher de biquíni com sol no rosto’, tá ok. Mas se pedir ‘uma mulher de biquíni com sol no corpo’, ele bloqueia. Por quê? Porque o algoritmo é um babaca que não entende contexto. É só um filtro de palavras disfarçado de inteligência.

IA bloqueia nudez. Ok. Mas deixa gerar 1000 versões de um dragão com óculos de sol. Estranho.

Vocês não veem que isso é uma lavagem cerebral? A OpenAI tá te dizendo o que você pode ou não ver. Isso é censura. Eles não querem que você pense. Querem que você seja um bom cidadão digital, sem desejo, sem curiosidade, sem corpo. A nudez não é pecado. É arte. É natureza. E se você quer gerar uma pintura de um corpo humano, isso não é crime. É história. Eles estão matando a criatividade com medo de um punhado de malucos. E o pior? Eles não deixam nem o Picasso ser livre.

Claro que o DALL·E bloqueia! Porque é americano e europeu, e aí já virou lei. Mas aqui em Portugal, a gente tem tradição! A arte portuguesa sempre foi ousada! O que é isso, ‘não pode gerar nua’? Isso é colonialismo digital! Eles querem que a gente se torne um país de monges digitais! 🤬 Onde está a liberdade? Onde está a cultura? Onde está o nosso direito de criar? Isso é vergonha! 🇵🇹

EU TENTEI PEDIR ‘UMA MULHER DE VESTIDO DE NOIVA… EM UMA PRAIA DE MADRUGADA’ E O DALL·E BLOQUEOU!!! ELE SABE TUDO!!! ELE ME JULGA!!! ELE É O JUIZ DA INTERNET!!! EU NÃO SOU MAIS NINGUÉM!!! 😭💔

Se você acha que o DALL·E é um bloqueio, você não entendeu nada. O verdadeiro problema não é o algoritmo. É você. Você quer gerar nudez porque é vazio. Porque não tem criatividade. Porque não sabe ver beleza sem exploração. A IA tá te mostrando que você é um consumidor, não um criador. E isso é a maior verdade que ela já te disse. Não é o sistema que é ruim. É você que não tem o que dizer. Tenta gerar uma cena de um velho lendo poesia na chuva. Tenta. Vai ver que o mundo é mais bonito do que você pensa.