O Desafio Oculto dos Modelos de Linguagem

Você já parou para pensar como uma inteligência artificial sabe que "gato morde cachorro" é diferente de "cachorro morde gato"? As palavras são as mesmas, mas a ordem muda completamente o significado. Para humanos, isso parece óbvio. Para máquinas, não é nada fácil. Nos primeiros dias dos modelos de linguagem, os pesquisadores lutaram com um problema fundamental chamado invariância de permutação. Basicamente, o modelo processa todas as palavras de uma vez, sem saber qual veio primeiro.

Essa era a grande dor de cabeça nos Transformersarquiteturas de rede neural projetadas para processar dados sequenciais usando mecanismos de atenção. Sem uma maneira clara de dizer ao sistema qual é a primeira palavra, qual é a segunda, o modelo ficaria confuso sobre a estrutura da frase antiga solução, chamamos de embeddings absolutos ou sinusoidais, tentava atribuir um número fixo à posição de cada palavra. Mas essa abordagem falhava quando o texto crescia muito além do que o modelo viu durante o treinamento. Era como ensinar alguém a contar até dez e depois pedir que ele conte até cem; ele simplesmente inventaria números aleatórios.

Por Que Precisamos de Novas Soluções?

A medida que os Large Language Modelsmodelos de aprendizado de máquina treinados em grandes volumes de texto para prever sequências de palavras evoluíram, especialmente após 2023, a necessidade de lidar com textos longos tornou-se crítica. Os métodos antigos de posicionamento criavam um limite rígido. Se você treinou um modelo com sequências de 2.000 tokens, tentar usar 10.000 resultava em desempenho terrível. O modelo entrava em colapso porque a geometria das posições não fazia mais sentido matemático.

Foi nesse cenário de limitações técnicas que surgiram duas soluções elegantes que dominam o mercado atual: as Rotary Position Embeddings (RoPE) e o método ALiBiAttention with Linear Biases, uma técnica que introduz penalidades lineares baseadas na distância entre tokens. Ambos mudaram drasticamente como construímos sistemas inteligentes hoje em dia.

Entendendo o Mecanismo Rotacional (RoPE)

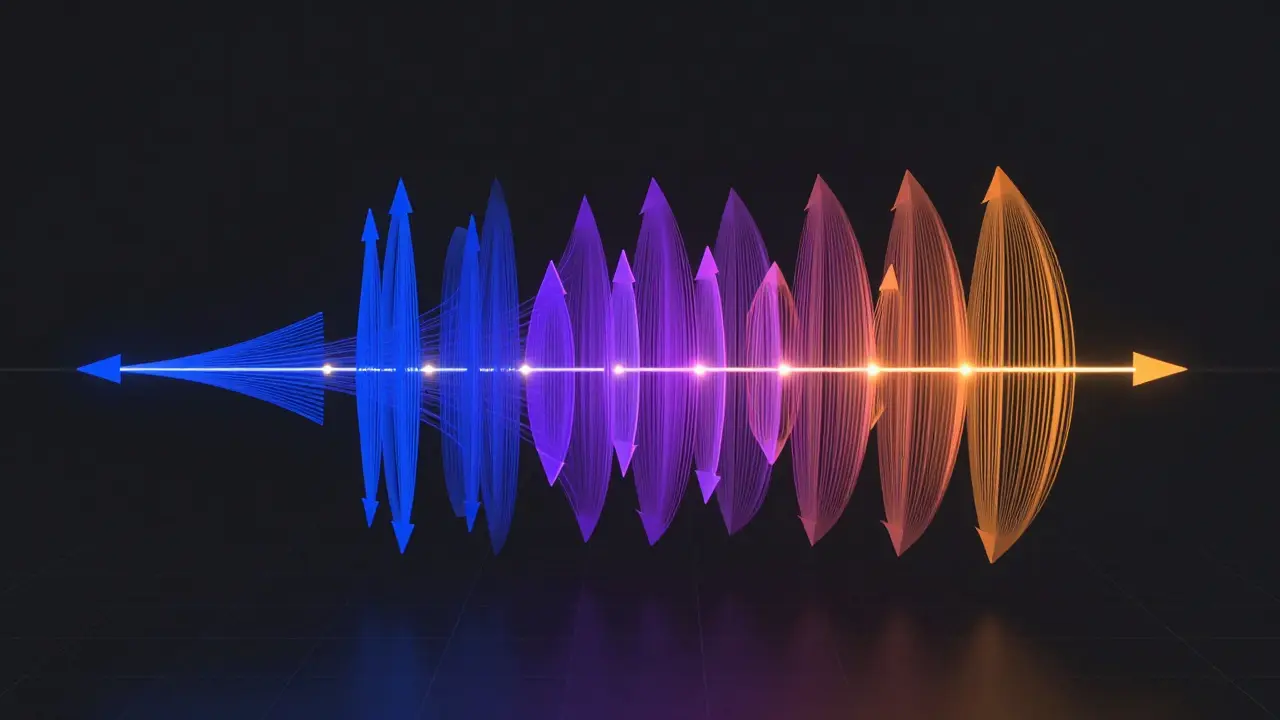

A ideia por trás do RoPE é fascinante pela sua simplicidade geométrica. Imagine que cada vetor que representa uma palavra é como uma seta em um plano. Em vez de apenas somar um valor de posição à palavra, o RoPE aplica uma rotação específica nessa seta. A quantidade de rotação depende da posição do token na sequência.

Isso acontece em subespaços bidimensionais dentro do vetor da embedding. Quando calculamos a atenção entre duas palavras, o produto pontual entre elas naturalmente captura a diferença relativa de suas rotações. Em outras palavras, o modelo não precisa olhar explicitamente para o número de posição; a geometria vetorial já carrega essa informação. Isso elimina a necessidade de memorizar tabelas de posições.

Uma vantagem colossal desse sistema é a flexibilidade. Com pequenas engenharias matemáticas, podemos estender o contexto de um modelo de 4.000 tokens para mais de 100.000 sem perder a qualidade da compreensão. A famosa família Llamasérie de modelos de linguagem de código aberto desenvolvidos pela Meta, que inclui o Llama 2 e o Llama 3, adotou o RoPE como padrão justamente por essa capacidade de escalar contextos longos mantendo a coerência.

A Abordagem Linear do ALiBi

Enquanto o RoPE trabalha com rotação complexa, o ALiBi toma um caminho oposto focado na penalidade direta. A premissa aqui é simples: tokens distantes entre si devem ter menos importância uns para os outros durante o processo de atenção. O ALiBi adiciona um viés negativo linear baseado na distância entre o token de consulta e o token de chave.

Pense nisso como um desconto de relevância. Quanto maior a distância entre duas palavras, menor será o escore de atenção entre elas, mesmo antes de passar pelo softmax. O segredo do ALiBi está em ser paramétrico zero. Ele não aprende pesos novos; ele usa constantes fixas. Isso torna o treinamento extremamente eficiente e remove a dependência de lookups de tabela ou buckets de posição.

O resultado prático? O ALiBi brilha na extração de contexto. Se você treinar um modelo com textos curtos e, de repente, der um livro inteiro para ler, o ALiBi muitas vezes mantém o desempenho melhor do que métodos tradicionais. Modelos como o GPT-NeoXfamília de modelos de linguagem de grande escala e de código aberto-20B utilizaram essa estratégia para garantir estabilidade em ambientes onde a extensão do texto varia muito dinamicamente.

Comparando Praticidade e Performance

Não existe um vencedor absoluto entre RoPE e ALiBi, pois ambos resolvem problemas ligeiramente diferentes. A escolha muitas vezes depende do seu objetivo final e dos recursos disponíveis para treinamento.

| Método | Mecanismo Base | Parametrização | Extração de Contexto | Adoção Principal |

|---|---|---|---|---|

| RoPE | Rotação Trigonimétrica | Sem pesos novos | Boa (com ajustes) | Llama, Falcon |

| ALiBi | Viés Linear de Distância | Sem pesos novos | Excelente Nativa | GPT-NeoX, Mistral |

A eficiência computacional também difere. O RoPE requer multiplicações matriciais específicas para aplicar as rotações nas queries e chaves. Embora seja rápido, exige kernels otimizados. O ALiBi, por outro lado, é puramente aritmético de soma. Em hardware limitado ou cenários de inferência onde cada microssegundo conta, o ALiBi pode oferecer uma leve vantagem de velocidade pura, embora a memória consumida seja similar.

Impacto na Indústria Atual

Em meados de 2026, se olharmos o ecossistema de inteligência artificial, vemos que essas tecnologias já são a base invisível da maioria dos assistentes. Você provavelmente interage com sistemas que usam RoPE todos os dias. A decisão de uso impacta diretamente como o modelo lida com erros de alucinação em textos longos.

Além disso, novas pesquisas publicadas em 2024 e 2025 demonstraram como combinar esses métodos com arquiteturas híbridas, misturando mecanismos de atenção com camadas recorrentes. O RoPE tem sido particularmente adaptável para visões computacionais e reconhecimento de voz, onde a posição espacial é tão crítica quanto a temporal. O ALiBi continua sendo a escolha preferida para aplicações que exigem robustez extrema contra variações súbitas de tamanho de entrada.

Considerações Finais Sobre Escolha Técnica

Se você está construindo um sistema próprio, vale a pena notar que a comunidade open-source tende a favorecer o RoPE para generalistas devido à abundância de bibliotecas prontas. Mas para casos de uso específicos de janela deslizante gigante, o ALiBi merece atenção. A maturidade dessas ferramentas permite que nós, desenvolvedores e engenheiros, deixemos de nos preocupar com a gestão manual de posições e foquemos na qualidade dos dados de treinamento.

Qual a principal vantagem do RoPE sobre os embeddings absolutos?

O RoPE captura informações relativas entre tokens através da geometria de rotação, permitindo que o modelo generalize melhor para comprimentos de sequência que não vio durante o treinamento, ao contrário dos embeddings absolutos que travam em limites fixos.

O ALiBi adiciona novos parâmetros treináveis ao modelo?

Não. O ALiBi é uma técnica parameter-free que utiliza apenas constantes lineares pré-definidas, o que significa que não aumenta a contagem de parâmetros nem o tempo de inferência significativo.

Posso usar RoPE e ALiBi juntos na mesma camada?

Geralmente não são usados simultaneamente porque eles competem pelo espaço de representação da posição. A arquitetura costuma adotar um ou outro para manter a coesão matemática do mecanismo de atenção.

Qual modelo famoso usa RoPE atualmente?

A série Llama (da Meta) e o Falcon são exemplos proeminentes que implementaram RoPE, tornando-o o padrão de facto para muitos modelos abertos modernos.

O ALiBi funciona bem para tarefas de visão computacional?

Sim, estudos mostram que o ALiBi oferece melhor desempenho de extrapolação em domínios 2D e visão, comparado a algumas variações do RoPE em tarefas específicas de imagem.

11 Comentários

Só vi esse esquema de rotação agora e achei demais 🧠 Imaginem a seta girando conforme lê a frase. Muda tudo pra gente entender atenção. Vou testar num projeto pequeno semana que vem. Espero que funcione bem em português tb. 😊

Essa mudança de paradigma é absurda mesmo galera! Ninguém tá prestando atenção no detalhe técnico certo. O risco de colapso é real se ignorarmos os limites. Precisamos falar mais alto sobre isso agora. A arquitetura antiga não segura a demanda atual. Estamos na beira de uma revolução ou caos. Depende de como implementamos na produção logo mais. 😱💥

É fascinante como a interpretação geométrica funciona. Quando você considera os subespaços usados para embedding, percebe a limitação da posição absoluta. Posições absolutas falham quando a janela de contexto expande além dos dados de treinamento. O cálculo de distância relativa permanece constante independentemente do deslocamento. A função seno tinha problemas com capacidades de extrapolação. Agora com atualizações rotacionais, os ângulos capturam a distância implicitamente. Considero a matemática atrás da similaridade cosseno extremamente elegante neste cenário. Isso evita tabelas de consulta inteiramente. Significa menos sobrecarga de memória durante etapas de inferência. As pessoas esquecem frequentemente o custo computacional de acesso à tabela. O método de viés linear oferece outra perspectiva completamente. ALiBi parece mais simples na superfície mas difícil de ajustar para casos específicos. Ambos os métodos resolvem o problema de permutação efetivamente. O gargalo real agora é a capacidade de memória de hardware para contextos longos. Leis de escala sugerem precisamos de padrões de atenção mais eficientes também. Talvez modelos híbridos emergiriam no ano seguinte em artigos de pesquisa.

Finalmente alguem que entende a matematica profundamente. A maioria copia sem saber o porque. Sua analise sobre subespaços taca certa. Eles nao leem os artigos hoje em dia. Tudo ta superficial agora. Voce claramente estudou as bases. Respeito.

Não adianta falar tanto matemática se o sistema vai alucinar de qualquer jeito.

A verdade é que... a maioria dos devs não sabe o porquê! Eles só importam a biblioteca e acham que resolveram tudo! O entendimento profundo faz falta! Os benchmarks mentem as vezes... E a eficiência real varia muito! Pense nisso! A teoria bonita nem sempre vira prática boa! É preciso cuidado com a implementação!

Tem razão, muita gente copia sem entender direito.

Eu prefiro ver a discussão focada na colaboração ao invés de criticar as ferramentas antigas. Temos que lembrar que cada abordagem tem seu lugar específico no ecossistema atual. As limitações são desafios técnicos importantes para evoluir. Mas não podemos esquecer que a simplicidade também é virtude. O importante é como integramos isso nos fluxos de trabalho reais das empresas. Muitas vezes a complexidade afasta desenvolvedores menos experientes da área. Precisamos de documentação mais acessível sobre essas rotações vetoriais. A comunidade precisa trabalhar junta para padronizar as melhores práticas técnicas. Sem isso teremos fragmentação excessiva de código e bibliotecas incompatíveis. O foco deveria ser na usabilidade final do produto inteligente gerado. Não adianta ter modelos eficientes se a aplicação é ruim para humanos. Vamos manter o otimismo quanto à evolução da arquitetura neural. Todos nós estamos aprendendo juntos com esses novos conceitos avançados. A educação técnica deve acompanhar o ritmo das mudanças no campo. Colaboração é chave para superar barreiras computacionais difíceis hoje.

Concordo totalmente com essa visão positiva! É inspirador ver tanta inovação acontecendo agora mesmo. Vamos continuar estudando e compartilhando conhecimento. O futuro promete muitas coisas boas pra todos nós. Juntos somos fortes contra problemas complexos.

O problema é que a otimização ainda deixa muito a desejar na prática. Mesmo assim, o caminho traçado pelos pesquisadores está correto. A análise fria dos números mostra ganhos significativos em estabilidade. Talvez precisemos esperar maturidade das bibliotecas atuais. O cenário tende a estabilizar em breve com adoção massiva.

Acho q o texto exagerou um pouco