Você já pediu para uma IA resolver um problema de matemática e ela te deu a resposta certa, mas com um raciocínio que não fazia sentido nenhum? Isso acontece porque existe um abismo gigante entre raciocínio matemático real e a capacidade de prever o próximo token com base em padrões. Enquanto modelos de linguagem (LLMs) parecem ter dominado a aritmética básica, a verdadeira prova de fogo está nos benchmarks de nova geração, que agora tentam separar quem realmente "pensa" de quem apenas memorizou a internet.

A verdade é que os modelos estão ficando bons em "trapacear". Quando usamos datasets antigos, a IA pode ter visto a resposta durante o treinamento. Por isso, a indústria mudou o foco: não queremos mais saber se a IA acerta o resultado final, mas se ela consegue construir uma prova rigorosa e se mantém a lógica quando mudamos um simples número no enunciado.

O Mapa da Complexidade: Do Ensino Fundamental ao Doutorado

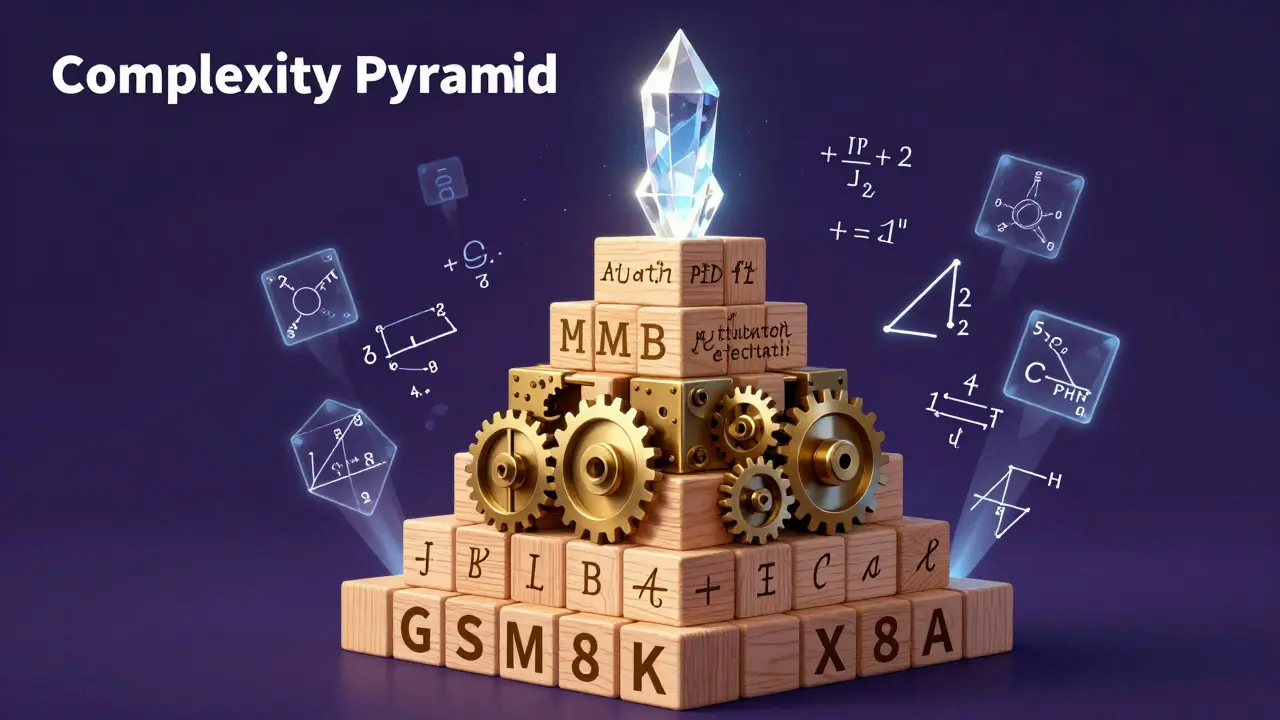

Para entender onde estamos, precisamos olhar para a hierarquia de testes. Não existe um único "teste de matemática", mas sim camadas de dificuldade que expõem fraquezas diferentes dos modelos.

No nível de entrada, temos o GSM8k, um conjunto de 8.500 problemas de matemática de escola primária. Modelos como o Gemini 2.5 Pro e o ChatGPT o3 atingem quase 90% de acerto aqui. Mas é aqui que mora o perigo: testes de perturbação mostram que, se você mudar os nomes ou os valores numéricos, a performance cai drasticamente. Isso indica que a IA muitas vezes reconhece o "estilo" da pergunta em vez de aplicar a lógica matemática.

Subindo a régua, encontramos o MATH dataset, com 12.500 problemas de nível médio e competição. Aqui, a dificuldade é dividida em níveis de 1 a 5. Enquanto modelos fechados beiram os 68% de acerto, eles colapsam em versões modificadas (como o MATH-P-Hard), onde a taxa de sucesso despenca para menos de 15%. Isso prova que a robustez do raciocínio ainda é frágil.

No topo da pirâmide, temos os benchmarks de nível de Olimpíada e Doutorado. A IMO 2025 (Olimpíada Internacional de Matemática) tornou-se o padrão ouro. Modelos da OpenAI e DeepMind conseguiram resolver 5 de 6 problemas, mas isso exigiu que eles "pensassem" por horas, e não segundos. Já em testes de nível de doutorado, como os baseados na obra de Roman Vershynin sobre Probabilidade de Alta Dimensão, a falha é quase total: nenhum modelo superou os 12% de acerto em provas complexas.

| Benchmark | Nível de Dificuldade | Acurácia Média (SOTA) | Principal Ponto de Falha |

|---|---|---|---|

| GSM8k | Fundamental | ~89% | Sensibilidade a mudanças numéricas |

| MATH | Médio/Competição | ~68% | Colapso em problemas perturbados |

| IMO 2025 | Olimpíada | Alta (com tempo extendido) | Geração de provas rigorosas |

| PhD-Level | Pesquisa/Doutorado | < 12% | Incapacidade de construir provas inéditas |

A Ilusão da Resposta Certa: Memorização vs. Raciocínio

A grande discussão atual entre pesquisadores, como os de Berkeley e ETH Zurich, é a diferença entre a resposta numérica e a prova lógica. Um modelo pode acertar que a resposta é "42", mas ao analisar o passo a passo, especialistas encontram raciocínios circulares em 32% dos casos e premissas incorretas em 27% das vezes.

Isso acontece porque as LLMs operam por reconhecimento de padrões. Quando o GSM-Symbolic foi criado, ele usou templates simbólicos para gerar variações do mesmo problema. O resultado foi chocante: a performance caiu entre 15 e 30 pontos percentuais. Basicamente, se você muda a "roupagem" do problema, a IA esquece como resolvê-lo.

Além disso, existe o problema do tempo de processamento. Noam Brown, da OpenAI, destacou que a evolução recente não foi necessariamente uma mudança qualitativa na inteligência, mas sim quantitativa no tempo de "reflexão". Os modelos agora usam cadeias de pensamento (Chain-of-Thought) extensas, podendo deliberar por horas internamente antes de emitir a resposta. É como se a IA estivesse testando vários caminhos e descartando os errados, em vez de simplesmente "saber" a resposta.

Sistemas Híbridos: O Futuro é Neural + Simbólico

Se as LLMs puras estão batendo em um teto, a solução parece estar na hibridização. Não adianta tentar prever a próxima palavra se você precisa de precisão absoluta em álgebra ou geometria. É aqui que entram as ferramentas externas e motores simbólicos.

O Gemini 2.5 Pro, por exemplo, utiliza hooks de invocação de ferramentas que roteiam subtasks para o Python ou WolframAlpha. Essa abordagem híbrida melhora a precisão em problemas complexos em até 38%, pois delega o cálculo pesado para um sistema que não comete erros de aritmética.

Um exemplo brilhante disso é o AlphaGeometry 2.0 do Google DeepMind. Ele combina a flexibilidade de um modelo de linguagem com a rigidez de um provador de teoremas formais. Em problemas de geometria da IMO, essa abordagem atingiu 74% de acerto, superando significativamente qualquer tentativa de LLM pura. A lição é clara: para a matemática, a intuição neural deve ser guiada por regras lógicas imutáveis.

Impacto no Mundo Real e a Barreira da Confiança

Para quem trabalha com ciência de dados ou engenharia, esses benchmarks não são apenas números de academia; eles definem se você pode ou não confiar na ferramenta. No setor de finanças quantitativas, por exemplo, 43% das firmas já usam LLMs para precificação de derivativos, mas com extrema cautela. Relatos de desenvolvedores indicam que, em cenários de estresse de mercado que exigem adaptação matemática real, a taxa de erro pode chegar a 73%.

Existe também uma pressão regulatória. A atualização de junho de 2025 do EU AI Act agora exige verificação matemática para sistemas de IA usados em modelagem financeira e engenharia estrutural. Isso significa que "confiar no prompt" não é mais legalmente aceitável em áreas críticas; você precisa de uma camada de verificação formal.

Para quem está implementando essas soluções, a recomendação é clara: nunca use a saída de uma LLM como verdade absoluta em matemática. A estratégia ideal é usar a IA para a decomposição do problema (quebrar em partes menores) e usar motores simbólicos como SymPy para a execução dos cálculos. Isso adiciona um pequeno atraso na resposta (cerca de 150ms), mas evita erros catastróficos.

O Que Esperar para 2027?

O caminho agora é a integração total de camadas de verificação. A Gartner prevê que até 2027, todos os LLMs de nível empresarial para matemática terão camadas de verificação formal integradas. Não veremos apenas modelos que "parecem" inteligentes, mas sistemas que podem provar matematicamente que sua resposta está correta antes mesmo de mostrá-la ao usuário.

O lançamento do MathOdyssey, com 15.000 problemas que vão do K-12 ao nível de pesquisa, deve forçar os desenvolvedores a abandonarem a cultura de "treinar no dataset de teste" e focarem em generalização real. Se queremos que a IA ajude a resolver a Hipótese de Riemann ou otimize a fusão nuclear, ela precisará parar de imitar matemáticos e começar a pensar como um.

O que é o efeito de perturbação nos benchmarks de matemática?

O efeito de perturbação ocorre quando pequenas mudanças em um problema (como alterar o valor de um número ou mudar o nome de um personagem), que não alteram a lógica da solução, causam uma queda drástica na acurácia do modelo. Isso revela que a IA estava memorizando o padrão do problema original em vez de aplicar o raciocínio matemático real.

Por que modelos de nível PhD ainda falham tanto?

Provas de nível de doutorado exigem a construção de argumentos inéditos e a manipulação de conceitos abstratos de alta dimensionalidade. As LLMs atuais são excelentes em combinar informações existentes, mas falham em criar novas estruturas lógicas rigorosas que não possuam análogos diretos em seus dados de treinamento.

Qual a diferença entre GSM8k e o dataset MATH?

O GSM8k foca em problemas de matemática básica de escola primária, exigindo raciocínio de múltiplos passos, mas com conceitos simples. Já o dataset MATH é voltado para competições de nível médio, cobrindo álgebra, geometria e teoria dos números, com níveis de dificuldade muito mais elevados (1 a 5).

O que é o Chain-of-Thought (Cadeia de Pensamento)?

É uma técnica onde o modelo decompõe o problema em etapas intermediárias de raciocínio antes de chegar à resposta final. Modelos mais recentes, como o o3 da OpenAI, expandiram isso para milhares de tokens, permitindo que a IA "delibere", tente caminhos diferentes e corrija seus próprios erros internamente.

Sistemas híbridos são realmente superiores?

Sim. Enquanto a parte neural (LLM) é ótima para entender a linguagem natural e planejar a estratégia de resolução, a parte simbólica (como Python ou Wolfram) é infalível em cálculos. A combinação reduz erros de alucinação numérica e aumenta a confiabilidade para uso profissional.