Perigos da IA: riscos reais que ninguém te conta

Quando você usa perigos da IA, riscos ocultos que surgem quando a tecnologia é usada sem consciência ou regulamentação. Também conhecida como armadilhas da inteligência artificial, essa realidade já afeta quem acredita que IA é só ferramenta útil. O problema não é a IA em si, mas como ela é usada — e por quem.

Um dos risco legal IA, consequências jurídicas por usar imagens, textos ou vozes geradas por IA sem autorização é mais comum do que você pensa. Muita gente baixa imagens de IA e coloca no Instagram, no site da empresa ou até em livros, achando que é livre. Mas se a imagem foi treinada com fotos de artistas sem permissão? Você pode ser processado. A UE e os EUA já exigem que você declare quando algo foi feito por IA — e esconder isso pode custar milhares de euros. Não é teoria. É lei.

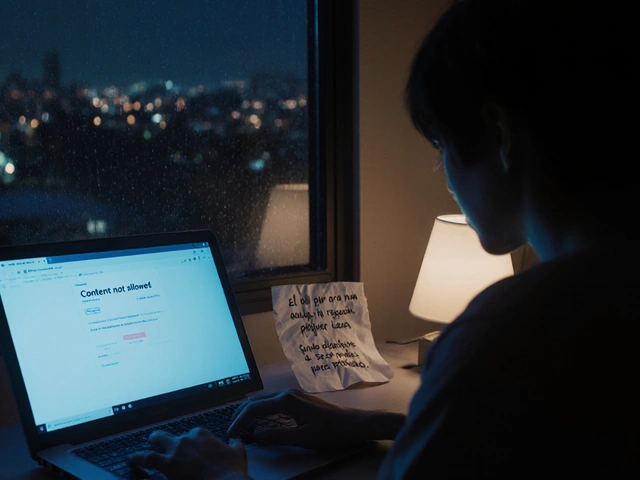

Outro privacidade IA, como plataformas de IA armazenam, analisam e às vezes vendem seus prompts e dados pessoais é quase invisível. Você digita um pedido no Crush AI, no Character AI ou em qualquer gerador de imagem e acha que é só seu. Mas muitos desses sistemas guardam seus inputs. Alguns até os usam para treinar modelos futuros. E se você pediu algo sensível? Seu histórico pode virar parte de um banco de dados comercial. E você nem foi avisado.

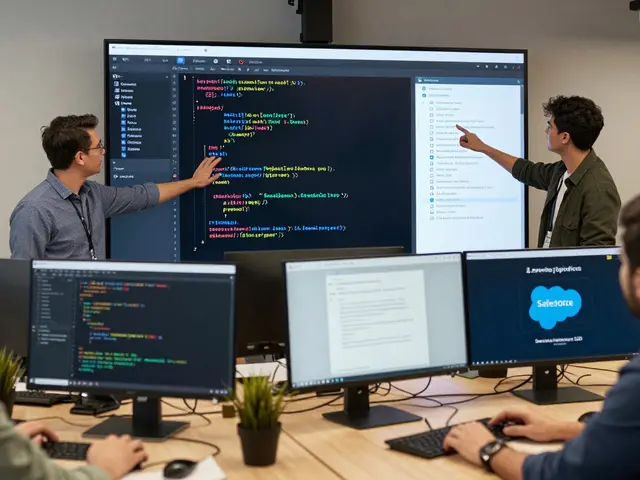

E tem o uso comercial de IA, quando empresas usam modelos de IA para produzir conteúdo, arte ou serviços sem pagar por direitos autorais ou ética. Artistas perderam empregos porque agências usaram IA para gerar logotipos, capas de livro e até peças de publicidade. Eles não pediram permissão. Não deram crédito. E agora, quem paga a conta? Você, se usar isso sem saber.

Quem tenta IA sem filtro, modelos de IA que não têm restrições éticas ou de conteúdo, muitas vezes para burlar controles, acha que está no controle. Mas o que acontece quando esses modelos geram discurso de ódio, deepfakes ou conteúdo ilegal? Você pode ser responsabilizado — mesmo que não tenha criado. Plataformas como Character AI já banem usuários por tentativas de contornar filtros. E não é só sobre banimento. É sobre rastreabilidade. Sua conta pode ser ligada a algo que você nem sabia que estava acontecendo.

Esses perigos não são futuros. Eles já estão aqui. E estão em posts que você já leu, em imagens que você já baixou, em prompts que você já usou. O que você faz com isso muda tudo. Não é sobre parar de usar IA. É sobre usar com olhos abertos. Na lista abaixo, você vai encontrar guias reais sobre como evitar essas armadilhas — desde como identificar se uma imagem foi feita por IA até quando vale a pena pagar por uma versão segura. Nada de teoria. Só o que funciona.