Se você trabalha com saúde e está pensando em usar ferramentas como ChatGPT, Gemini ou Claude para ajudar no atendimento, na documentação ou na análise de prontuários, pare agora. IA generativa não é inocente quando trata dados de pacientes. Usar essas ferramentas sem cuidado pode colocar seu hospital, clínica ou consultório em risco de multas milionárias, processos judiciais e perda de confiança dos pacientes.

O que realmente significa ser "HIPAA-compliant"?

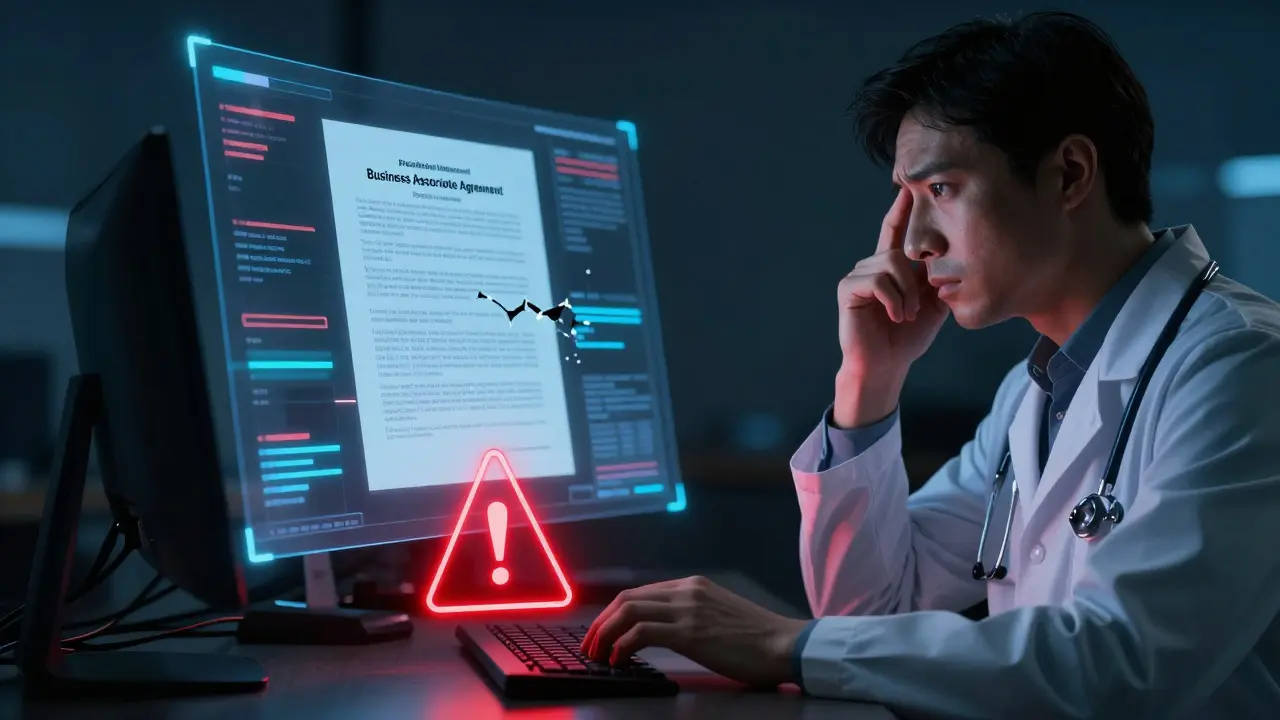

HIPAA não é um selo que você compra. É um conjunto de regras legais que exigem que qualquer organização que lide com informações de saúde proteja esses dados. Isso vale para hospitais, clínicas, seguradoras e até laboratórios. Quando você usa um sistema de IA que acessa, armazena ou processa informações de saúde - chamadas de ePHI (informações de saúde eletronicamente protegidas) -, esse sistema se torna um "associado de negócios". E isso muda tudo.Um associado de negócios é qualquer empresa que, por contrato, lide com dados de pacientes em nome de um provedor de saúde. E para isso, precisa assinar um Business Associate Agreement (BAA), um contrato legal que obriga a empresa a seguir as regras do HIPAA. Sem esse documento, você está violando a lei - mesmo que use criptografia, senhas fortes e firewalls.

As versões públicas de ChatGPT, Gemini e Claude não assinam BAAs. Isso significa que, mesmo que você não veja nenhuma evidência de vazamento, o simples ato de colar um prontuário ou um histórico médico nelas já é uma infração. Essas plataformas podem usar seus dados para treinar modelos futuros, vender insights ou até exibir informações em respostas públicas. Não há garantia de segurança. E a autoridade de fiscalização, o HHS OCR, já começou a aplicar multas por isso.

As três regras que não podem ser ignoradas

O HIPAA não é uma única regra. É um tripé:- Regra de Privacidade: define quem pode ver, usar ou compartilhar dados de saúde. Pacientes têm direito de saber como seus dados estão sendo usados e podem negar autorização.

- Regra de Segurança: exige proteção técnica. Isso inclui criptografia de dados em trânsito e em repouso, controle de acesso por função (quem vê o que), logs detalhados de quem acessou e quando, e sistemas de detecção de anomalias.

- Regra de Notificação de Vazamento: se algo der errado - mesmo que só um paciente seja afetado - você tem 60 dias para notificar o paciente e o governo. Atrasar ou esconder pode custar até US$ 1,5 milhão por violação.

Se a sua IA não cumpre essas três regras, ela não é segura. Ponto.

As únicas soluções que funcionam

Você não precisa abandonar a IA. Só precisa usar a certa. Existem plataformas que foram construídas desde o início para atender ao HIPAA. Elas não são só "mais seguras" - elas são legalmente habilitadas.BastionGPT é um exemplo. Ele usa versões específicas de modelos como GPT-5.2, Claude 3.1 e Gemini 3 Pro, mas em ambientes isolados, sem acesso à internet pública. Tudo é criptografado, os logs são auditáveis, e a empresa assina o BAA. O mesmo vale para CompliantGPT, que oferece versões personalizadas com controle total sobre onde os dados ficam armazenados - geralmente em nuvens certificadas como AWS ou Azure, que já têm aprovação do HITRUST CSF.

A AWS, por exemplo, tem mais de 177 serviços certificados pelo HITRUST CSF, incluindo Amazon Bedrock e Amazon SageMaker. Esses serviços permitem que hospitais criem seus próprios modelos de IA, treinados apenas com dados anônimos, dentro de um ambiente onde a infraestrutura já cumpre HIPAA. É o caminho mais seguro: você controla o que entra, o que sai e como o modelo aprende.

De-identificação: a saída inteligente

E se você não quiser usar uma plataforma pronta? A saída é de-identificar os dados. HIPAA permite usar informações de saúde se elas forem transformadas em algo que não pode ser ligado a uma pessoa específica. Existem dois métodos aprovados:- Método de Exclusão: remove 18 identificadores diretos, como nome, CPF, data de nascimento, endereço, número de telefone, e até códigos de exames que podem ser rastreados.

- Determinação de Especialista: um profissional com conhecimento técnico e legal avalia se os dados foram suficientemente anonimizados. Isso exige experiência - e documentação.

Com dados de-identificados, você pode usar o ChatGPT público sem violar a lei. Mas cuidado: se o dado não foi realmente desidentificado - se restou algum padrão, como combinação rara de sintomas, idade e localização - você ainda está em risco. Muitas clínicas acham que "tirar o nome" basta. Não basta. Um estudo da Universidade de Stanford em 2024 mostrou que modelos de IA conseguem reidentificar pacientes com 87% de precisão mesmo em dados "anônimos".

FDA: quando a IA vira um dispositivo médico

Aqui é onde muitos esquecem de olhar além do HIPAA. Se sua IA não só processa dados - mas faz diagnósticos, recomenda tratamentos ou decide se um paciente deve ser encaminhado - ela pode ser classificada pela FDA como um Software as a Medical Device (SaMD), ou software como dispositivo médico.Isso muda tudo. A FDA não só exige segurança de dados. Ela exige que o software seja validado clinicamente. Ou seja: você precisa provar, com estudos clínicos, que a IA acerta mais do que erra. Que ela não piora diagnósticos. Que ela não tem viés racial, de gênero ou socioeconômico.

Em 2025, a FDA publicou um plano de ação para IA/ML em dispositivos médicos. O que isso significa? Se você desenvolve uma IA que sugere um medicamento baseado em sintomas de um paciente, e esse conselho é usado para tomar uma decisão clínica - você está sujeito a inspeções, auditorias e até recall de software. Não há "teste grátis". Se a IA errar e um paciente sofrer danos, a responsabilidade legal cai sobre quem a implementou - não sobre a empresa que vendeu o modelo.

Reclamações clínicas: quem responde quando a IA erra?

Imagine isto: um paciente entra com dor no peito. A IA analisa o histórico, o exame de sangue e o ECG, e diz: "provavelmente é ansiedade". O médico confia. Dois dias depois, o paciente sofre um infarto. A IA errou. Quem é responsável?É aqui que a legislação fica confusa. Nos EUA, a responsabilidade legal ainda recai sobre o profissional de saúde que usou a IA. Mas isso está mudando. Novas propostas de lei, como a AI Liability Act de 2025, começam a exigir que fornecedores de IA médica assumam parte da responsabilidade. Isso já está sendo discutido em tribunais federais.

Clínicas que usam IA para gerar relatórios, resumos de consultas ou até respostas automáticas para pacientes estão criando "reclamações clínicas". Se a IA escrever algo incorreto, e o paciente sofrer por isso, você pode ser processado por negligência. E o seguro médico pode se recusar a pagar.

Como começar do jeito certo

Se você está pensando em usar IA na saúde, aqui está o passo a passo real:- Defina o uso: A IA vai apenas ajudar na redação? Ou vai tomar decisões clínicas? O nível de risco muda completamente.

- Verifique o fornecedor: Pergunte: "Você assina BAA?" Se a resposta for não, desista. Se for sim, exija ver o documento.

- Use ambientes controlados: Nunca cole dados reais em ferramentas públicas. Use plataformas certificadas ou dados de-identificados.

- Implemente auditoria contínua: Monitore logs de acesso. Revise respostas da IA com um profissional. Use "human-in-the-loop" sempre que possível.

- Capacite sua equipe: Treine médicos, enfermeiros e administradores sobre o que pode e o que não pode ser digitado em uma IA.

Quem tenta economizar tempo usando ChatGPT livre está jogando com fogo. A multa média por violação do HIPAA em 2025 foi de US$ 1,2 milhão. O custo de um processo judicial pode chegar a US$ 10 milhões. E o dano à reputação? Impossível de calcular.

Conclusão: IA não é um atalho - é um compromisso

A IA pode salvar vidas. Mas só se for usada com responsabilidade. Não é sobre ser tecnológico. É sobre ser ético. É sobre respeitar a lei. É sobre proteger quem confiou em você.Se você não tem certeza se sua solução é segura, pare. Consulte um especialista em conformidade. Não espere um vazamento para agir. O risco não é futuro. Ele está aqui, agora, enquanto você lê isso.

Posso usar o ChatGPT gratuito para escrever prontuários?

Não. Mesmo que você não salve os dados, o simples ato de digitar informações de saúde - como nome, diagnóstico ou exames - em ferramentas públicas como ChatGPT viola o HIPAA. O provedor pode armazenar, usar ou até treinar modelos com esses dados. Não há garantia de segurança. Use apenas plataformas que assinam BAA e têm certificação HIPAA.

O que é um BAA e por que ele é tão importante?

BAA significa Business Associate Agreement. É um contrato legal que obriga uma empresa terceira - como uma plataforma de IA - a proteger dados de saúde conforme as regras do HIPAA. Sem ele, você não pode usar qualquer serviço que processe, armazene ou transmita informações de pacientes. É o único documento que te protege legalmente. Sem BAA, você é o responsável por qualquer vazamento.

A FDA aprova todas as IA usadas na saúde?

Não. A FDA só aprova IA que atua como dispositivo médico - ou seja, que faz diagnósticos, recomenda tratamentos ou decide sobre intervenções clínicas. Se a IA só ajuda a escrever relatórios, ela não precisa de aprovação. Mas se ela sugerir um medicamento, um exame ou um risco de morte, então sim: ela precisa ser validada clinicamente e registrada como SaMD. Caso contrário, você pode ser responsabilizado por uso inadequado.

Como saber se os dados estão realmente de-identificados?

Remover nome e CPF não é suficiente. Um estudo da Universidade de Stanford mostrou que IA consegue reidentificar pacientes com 87% de precisão mesmo em dados "anônimos". Para garantir, você precisa usar o método de exclusão dos 18 identificadores do HIPAA ou contratar um especialista em anonimização. O ideal é usar ferramentas que automatizam esse processo, como as oferecidas por AWS e Azure, que já têm validação técnica.

Se eu usar AWS ou Azure, estou automaticamente em conformidade?

Não. A AWS e a Azure oferecem serviços certificados, mas você ainda precisa configurar corretamente. Se você usar um serviço não-HIPAA para armazenar ePHI - mesmo que a nuvem seja segura - você ainda está em violação. A responsabilidade é sua. Verifique qual serviço você está usando, confirme se ele está listado como "HIPAA-eligible" e assine o BAA com a nuvem. Só então você estará em conformidade.

12 Comentários

Essa porra de IA tá matando a medicina. Você coloca um prontuário no ChatGPT e ele vira um meme no feed de alguém. Já vi clínica inteira ser processada por causa disso. E o pior? O médico nem liga. Só quer economizar 10 minutos digitando. Vai tomar no cu, HIPAA não é sugestão, é lei.

Se você acha que só remover nome e CPF resolve, você não entende nada de privacidade de dados. Stanford provou que IA consegue reidentificar paciente com 87% de precisão. Isso não é tecnologia, é bruxaria. E ainda tem gente que usa o GPT grátis pra resumir consultas. Você não está sendo esperto, está sendo um risco público.

Você pensa que o HIPAA é só um documento? Não. É a diferença entre você continuar trabalhando ou virar um número em uma lista de multas. E não adianta dizer que "não tem problema". O HHS OCR já multou 3 hospitais em 2025 por isso. Um deles tinha só 2 pacientes afetados. Dois. Dois pacientes. E a multa foi de US$ 1,8 milhão. Você quer ser o próximo? Então pare de ser burro e leia o que o post diz. BAA não é opcional. É obrigatório. Ponto.

Eu li o post inteiro. Só pra confirmar: usar GPT grátis é suicídio profissional. Ok. Agora me conta como eu faço pra escrever 50 prontuários por dia sem morrer de tédio? Ninguém resolveu isso. Só avisou que é perigoso. Obrigada, Captain Obvious.

Essa porra toda é só mais um jeito dos EUA controlarem o mundo. Brasil não precisa de HIPAA. Nós temos ética. Nós temos juízo. Mas não, tem que copiar essa burocracia americana. E agora vão nos obrigar a pagar milhares por um BAA que ninguém entende? Puts, isso é colonialismo digital. Quem inventou isso é um norte-americano com medo de ser processado por um paciente que digitou "dor de cabeça" no GPT.

Se você não sabe o que é HITRUST CSF, não tem autoridade pra falar sobre conformidade. AWS e Azure não são soluções mágicas. São infraestruturas. Você ainda precisa configurar os serviços corretamente. Muita clínica compra o serviço "HIPAA-eligible" e depois usa o bucket errado. Resultado? Vazamento. A culpa não é da nuvem. É da pessoa que não leu o manual. Leiam os documentos. Não achem que "ter um BAA" é suficiente. É só o primeiro passo.

Essa história toda me fez pensar: e se a IA não for o problema? E se o problema for a gente? A gente quer automação porque é preguiçoso, não porque é eficiente. Queremos que a máquina escreva o prontuário, tome decisão, responda paciente... mas não queremos assumir a responsabilidade. A IA é só um espelho. Ela não mente. Ela só reflete nossa preguiça, nossa arrogância, nossa falta de preparo. Talvez o real risco não seja a tecnologia... mas o profissional que a usa sem entender.

Eu trabalho em uma clínica pequena e a gente usava o GPT pra resumir consultas. Até que um dia um paciente reclamou porque o relatório disse que ele tinha "sintomas de depressão leve". Ele não falou nada disso. A IA inventou. Foi um caos. Aí a gente parou. Hoje usamos um sistema interno com BAA. Não é rápido. Mas ninguém foi processado. E os pacientes confiam mais. Vale a pena. Não é sobre economizar tempo. É sobre não destruir sua carreira por preguiça.

Então a solução é... usar AWS? 💅

Claro. Porque nada diz "eu sou profissional" como colocar tudo na nuvem e depois esquecer que você esqueceu de assinar o BAA. 🤦♀️

Meu Deus, a gente tá tão perdido que virou um meme de conformidade.

Quem escreveu esse post é um anjo disfarçado de advogado de saúde. Tudo está perfeito. Cada ponto, cada vírgula, cada referência. E mesmo assim, tem gente que ainda acha que "tirar o nome" é suficiente. Você não está sendo criativo. Você está sendo um criminoso negligente. HIPAA não é um desafio. É um contrato moral. E você? Você está violando ele com a mesma desculpa que um ladrão usa: "não foi pra roubar, foi só pra ver".

Interessante como a ética da saúde se tornou uma questão de compliance. Antes, era sobre cuidado. Hoje, é sobre evitar multas. Não que eu seja contra a segurança. Mas quando a medicina vira um checklist de contratos e certificações, perdemos o que realmente importa: o ser humano. A IA não é o vilão. A burocratização da empatia é.

Se você tá usando Azure e não assinou o BAA, você é tão burro quanto quem coloca o CPF no Google. Não adianta ter criptografia se você não tem contrato. E não me venha com "mas o servidor é seguro". Seguro não é o suficiente. Legal é. E aí, onde tá seu BAA? 🤡